Expertos en inteligencia artificial están alerta ante los sesgos raciales y de género presentes en los sistemas de reconocimiento facial y otras tecnologías, destacando el impacto negativo en los derechos fundamentales y la inclusión social. La activista Joy Buolamwini lidera la lucha por una mayor responsabilidad en el uso de la IA.

La presencia de sesgos raciales y de género en los sistemas de #inteligencia artificial (IA) se ha convertido en un tema de gran preocupación entre científicos, activistas y organizaciones dedicadas a la defensa de los derechos digitales.

Diversos estudios y experiencias han evidenciado que muchas tecnologías de reconocimiento facial y otros sistemas automatizados muestran prejuicios que afectan de manera desproporcionada a personas de color, mujeres y grupos vulnerables, poniendo en riesgo libertades fundamentales como la libertad de expresión, movimiento y desarrollo personal.

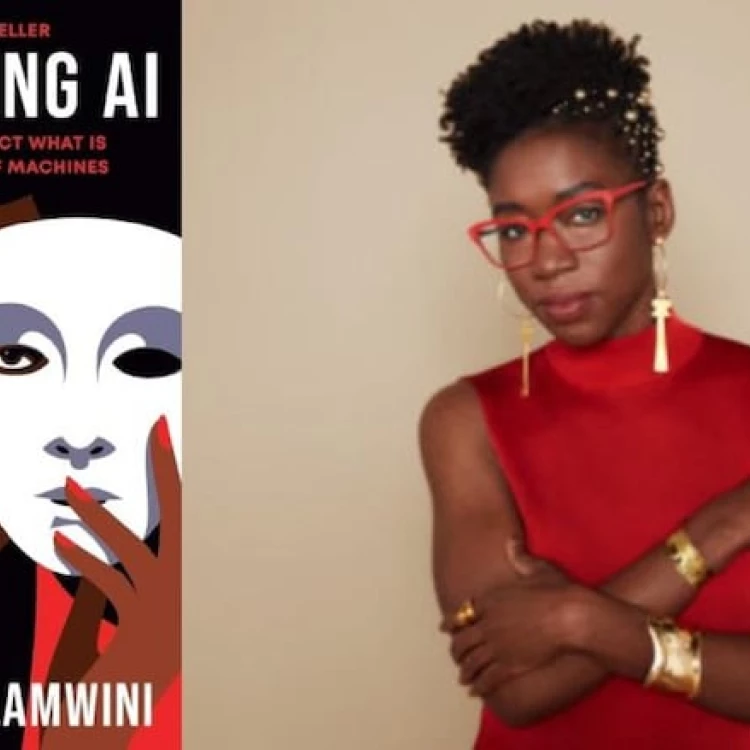

Joy Buolamwini, investigadora en MIT y fundadora de la Liga por la Justicia Algorítmica, ha sido una figura destacada en la denuncia de estos problemas.

Su trabajo reveló que los algoritmos de reconocimiento facial de empresas tecnológicas como Microsoft, IBM y Amazon tienden a fallar al identificar correctamente a personas con piel oscura, especialmente a mujeres.

En algunos casos, estos sistemas llegaron a no detectar rostros oscuros o a etiquetarlos erróneamente, generando potenciales peligros, como arrestos injustificados o violaciones de privacidad y derechos civiles.

El descubrimiento de Buolamwini surgió mientras realizaba un proyecto creativo en el que intentaba detectar su rostro con diferentes sistemas de reconocimiento.

Ella contó que, al usar una máscara blanca durante una festividad, los algoritmos detectaban claramente la máscara, pero cuando se quitaba, su rostro de piel oscura no era reconocido.

Este simple experimento evidenció cómo las máquinas reflejan prejuicios arraigados en los datos y algoritmos con los que fueron entrenadas.

La problemática de los sesgos en IA no es nueva, pero en los últimos años ha escalado su gravedad con el uso masivo de estas tecnologías en ámbitos como la seguridad, el control policial y las redes sociales.

Casos como la falsa detención de personas por reconocimiento facial mal interpretado, o la proliferación de deepfakes no consentidos, subrayan la necesidad de establecer marcos de regulación y responsabilidad.

¿Cuánto afecta, para bien y para mal, la IA a la información? Primer foro de debate en Zaragoza

El Ayuntamiento de Zaragoza ha acogido hoy el primer foro de debate sobre inteligencia artificial e información organizado por Periodismo 2030. Descubre las conclusiones de la encuesta nacional sobre medios de comunicación en relación a la IA.La historia reciente muestra que estas tecnologías se han implementado sin suficiente control, a veces con consecuencias devastadoras. Por ejemplo, en Estados Unidos, varias personas de raza negra han sido arrestadas por errores de reconocimiento facial en situación de alta tensión, incluso con situaciones donde las propias fuerzas policiales reconocen errores en los sistemas utilizados.

Buolamwini denuncia que estas fallas no son accidentes, sino resultado de una negligencia deliberada de algunas corporaciones que priorizan el mercado y la innovación sin tener en cuenta los impactos sociales.

La falta de diversidad en los datos de entrenamiento y la invisibilización de distintas realidades contribuyen a perpetuar los prejuicios en las máquinas.

La justicia algorítmica exige que estas tecnologías sean auditadas y corregidas

Expertos y activistas llaman a una mayor regulación y transparencia en el desarrollo y uso de la IA. La justicia algorítmica exige que estas tecnologías sean auditadas y corregidas, garantizando que no refuercen desigualdades ni discriminen a ciertos grupos.

La lucha de Buolamwini va más allá del ámbito técnico: representa un llamado a la sociedad para exigir un uso ético y responsable de la inteligencia artificial, que respete los derechos humanos y promueva la inclusión.

En un contexto global donde la inteligencia artificial avanza rápidamente, la reflexión sobre su impacto social y ético se vuelve más urgente que nunca.

La misma historia de avances tecnológicos nos recuerda que el desarrollo no debe dejar atrás la justicia social y la protección de las libertades individuales.

La batalla contra los sesgos en la IA es, en definitiva, una lucha por la igualdad y la dignidad en la era digital.